2.4 IMPLICACIONES ÉTICAS Y POLÍTICAS DEL DISEÑO Y USO DE SISTEMAS DE IA

CRITERIO DE EVALUACIÓN

▪ CA2.4. Identificar y evaluar las implicaciones éticas y políticas del diseño y uso de sistemas de inteligencia artificial, incluida la equidad, el sesgo, la discriminación y la rendición de cuentas.

- Equidad: Tratamiento justo y sin prejuicios de todas las personas, independientemente de su género, raza u otras características.

- Sesgo: Inexactitudes o distorsiones en los resultados de la IA debido a datos de entrenamiento parciales o prejuicios implícitos.

- Discriminación Algorítmica: Situación en la que los sistemas de IA perpetúan desigualdades y prejuicios presentes en los datos.

- Responsabilidad Ética: Obligación de asegurar que los sistemas de IA tomen decisiones justas y responsables, y de asumir las consecuencias de esas decisiones.

- Transparencia: Claridad en el funcionamiento y toma de decisiones de los sistemas de IA para que los usuarios puedan entender cómo se llega a resultados.

La equidad y el sesgo son cuestiones cruciales. Los sistemas de IA pueden perpetuar desigualdades si no se diseñan para ser equitativos y libres de sesgo. La discriminación, por ejemplo, puede surgir cuando los datos de entrenamiento contienen prejuicios culturales.

La responsabilidad es otro factor clave. Las decisiones tomadas por sistemas de IA pueden tener un gran impacto en la sociedad, lo que lleva a la pregunta de quién es responsable en caso de decisiones incorrectas o perjudiciales. La transparencia también es fundamental para que los usuarios comprendan cómo se toman las decisiones de la IA y puedan confiar en ellas.

Equidad y Sesgo:

- Equidad: Los sistemas de IA deben ser diseñados para tratar a todos los usuarios de manera justa y sin discriminación.

- Sesgo: La falta de representatividad en los datos de entrenamiento puede llevar a decisiones sesgadas y discriminatorias.

Discriminación y Responsabilidad:

- Discriminación: Los sistemas de IA pueden perpetuar prejuicios y discriminación si no se controlan adecuadamente.

- Responsabilidad: Las personas y las empresas deben asumir la responsabilidad de las decisiones tomadas por los sistemas de IA.

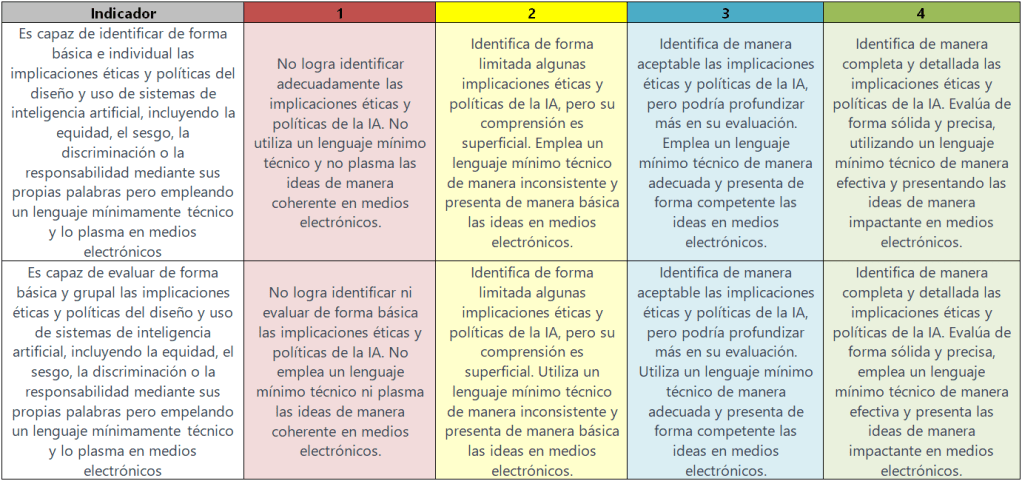

Rúbrica de Evaluación

- 1: No cumple con los requisitos del criterio de evaluación.

- 2: Cumple parcialmente con los requisitos, pero de manera insatisfactoria.

- 3: Cumple satisfactoriamente con los requisitos del criterio de evaluación.

- 4: Cumple excelentemente con los requisitos del criterio de evaluación, mostrando un alto nivel de comprensión, habilidades de comunicación, trabajo en equipo (si procede), gestión del tiempo, creatividad e innovación.

Sesión 1: Introducción a las Implicaciones Éticas y Políticas de la IA (50 minutos)

- Informe de The New York Times sobre el sistema de contratación de Amazon: https://www.nytimes.com/2018/10/10/technology/amazon-hiring-artificial-intelligence.html

- Noticia sobre arresto erróneo por reconocimiento facial: https://www.nytimes.com/2020/06/24/technology/facial-recognition-arrest.html

- Informe sobre discriminación en Apple Card: https://www.reuters.com/article/us-goldmansachs-apple-credit/apple-co-founder-says-goldman-sachs-credit-card-discriminates-against-women-idUSKBN1XN2G2

- Caso del accidente de coche autónomo de Uber: https://www.nytimes.com/2018/03/19/technology/uber-driverless-fatality.html]

CA2.4-V1 NUBE DE IMPLICACIONES

Actividad Individual: Nube de Palabras

Cada alumno creará una nube de palabras usando herramientas en línea o de dibujo. Deberán identificar y plasmar al menos 20 términos relacionados con las implicaciones éticas y políticas de diseño y uso de la IA. Estos términos pueden incluir: equidad, sesgo, discriminación, responsabilidad, privacidad, toma de decisiones, automatización, transparencia, control, etc.

Sesión 2: Evaluación de Implicaciones Éticas y Políticas en Grupos

CA2.4-01 IMPLICACIONES ÉTICAS O POLÍTICAS

Actividad Grupal: Evaluación y Presentación de Implicaciones

Por grupos de 3 personas se seleccionará una implicación ética (por ejemplo, el sesgo) para analizar en detalle.

Cada grupo se enfocará en una implicación ética o política (por ejemplo, el sesgo) y deberá:

• Investigar en línea y recopilar información sobre cómo esta implicación puede surgir en sistemas de IA, tanto en diseño como en uso.

• Evaluar los posibles impactos positivos y negativos de esta implicación en la sociedad.

• Proponer posibles soluciones o enfoques para minimizar los impactos negativos.

• Crear una presentación digital (diapositivas, video, infografía, etc.) para comunicar sus hallazgos y soluciones.

Sesión 3: Presentación y Reflexión

Los grupos finalizarán sus presentaciones si es necesario y presentarán sus hallazgos y soluciones al resto de la clase.

Debatiremos y discutiremos las diferentes presentaciones de forma participativa por turnos, y el intercambio de ideas sobre las implicaciones éticas y políticas de la IA. Todo el mundo dará su opinión y se respetará el turno de palabra penalizándose si no se cumple esta norma

Haremos una reflexión sobre cómo nuestras decisiones pueden influir en la ética y política de la IA.

Debe estar conectado para enviar un comentario.